Depuis fin novembre, vous avez peut-être remarqué que de nombreux reportages fleurissaient dans les grands médias (sur Ouest-France, au 20h de TF1 ou encore sur Le Monde.fr entre autres) à propos de ChatGPT . Cet outil de conversation, s’appuyant sur l’intelligence artificielle et développé par l’entreprise américaine OpenAI, est désormais accessible au grand public à travers sa plateforme en ligne et une inscription gratuite. Intrigué par l’engouement des journalistes quant à cet outil, nous avons décidé de poser quelques questions à l’outil de conversation à propos des liens entre journalisme et intelligence artificielle. Ses réponses sont retranscrites telles que le système nous les a renvoyées, sans aucune correction ni traduction, ChatGPT répondant dans un français (quasi) parfait. Le texte en italique est produit par Fragil pour apporter des compléments d’informations et des pistes de réflexions en lien avec la mission d’éducation aux médias de l’association.

Il est à noter que l’image d’illustration a été produite avec Midjourney, un outil s’appuyant aussi une intelligence artificielle, avec la seule requête textuelle « journalism and artificial intelligence ».

Fragil : Comment vous définiriez-vous ?

ChatGPT : « Je suis un programme informatique, plus précisément un modèle de langage entraîné par OpenAI. Mon but est de fournir des informations et des réponses à des questions posées en langage naturel, en utilisant l’apprentissage automatique pour traiter et comprendre le langage humain. Je suis capable de produire du contenu original, mais je ne suis pas conscient et je n’ai pas d’opinions ou de sentiments personnels. Je suis un outil conçu pour aider les gens à obtenir des informations et à résoudre des problèmes, rien de plus. »

Remarques de Fragil : Comme pour la suite de cette « interview », les textes produits seront écrits dans un français parfait (à l’exception d’une seule faute nous semble-t-il), le niveau de langage correspond à un niveau attendu dans n’importe quel média généraliste. Ce texte pourrait être produit par n’importe quelle personne chargée de la communication de OpenAI.

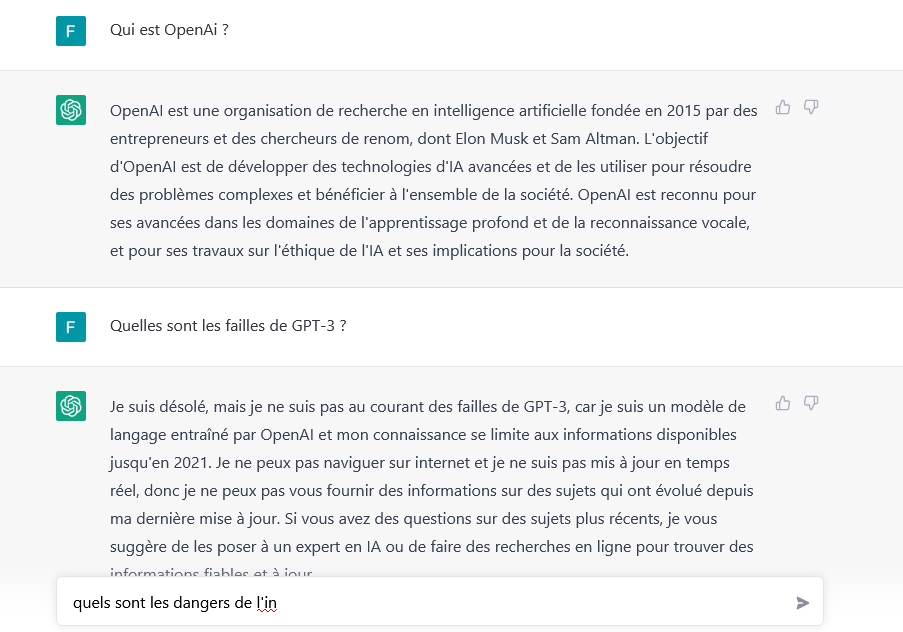

Qui est OpenAi ?

« OpenAI est une organisation de recherche en intelligence artificielle fondée en 2015 par des entrepreneurs et des chercheurs de renom, dont Elon Musk et Sam Altman. L’objectif d’OpenAI est de développer des technologies d’IA avancées et de les utiliser pour résoudre des problèmes complexes et bénéficier à l’ensemble de la société. OpenAI est reconnu pour ses avancées dans les domaines de l’apprentissage profond et de la reconnaissance vocale, et pour ses travaux sur l’éthique de l’IA et ses implications pour la société. »

Elon Musk est devenu « l’homme le plus riche du monde » en 2021, avec une fortune estimée à plus de 200 milliards de $. Associé au succès de Paypal, fondateur de SpaceX, propriétaire de Tesla et récemment de Twitter, il s’illustre régulièrement par ses positions libertariennes, notamment sur sa promotion de la liberté d’expression totale, même pour des personnes diffusant des discours de haine. Sam Altman est un entrepreneur/investisseur/développeur impliqué dans de nombreuses sociétés technologiques. Il est bon de souligner qu’ après avoir été une association à but non lucratif jusqu’en 2019, OpenAI est devenue une entreprise à « but lucratif plafonné », limitant les gains de ses investisseureuses à 100 fois la mise.

Quels sont les dangers de l’intelligence artificielle pour l’information ?

« L’intelligence artificielle peut présenter des dangers pour l’information en raison de son potentiel pour manipuler les données ou pour produire du contenu trompeur ou faussé. L’IA peut également être utilisée pour cibler les individus avec des messages personnalisés dans le but de les influencer ou de les manipuler, ce qui peut créer une désinformation massive et menacer la liberté d’expression et la démocratie. De plus, l’IA peut entraîner une certaine dépendance vis-à-vis de ses outils et de ses algorithmes, ce qui peut limiter notre capacité à penser par nous-mêmes et à prendre des décisions éclairées. Enfin, l’utilisation excessive de l’IA dans les médias peut également entraîner la suppression de emplois et la marginalisation de certains professionnels. »

La réponse générée par ChatGPT est saisissante tant au niveau de la forme que du fond. Sur une notion aussi complexe que « les dangers pour l’information », le chatbot explore quatre pistes de réflexion : la création de fausses information, le ciblage d’audience, la perte de maîtrise des outils et l’impact sur l’emploi des journalistes. Un élément de la réponse nous interroge cependant. En utilisant la formule « notre capacité à penser par nous-mêmes« , ChatGPT semble s’inclure dans l’humanité, créant dans cette phrase une confusion sur l’auteurice véritable de la réponse, à savoir un algorithme et non une personne humaine.

Comment identifier un texte écrit par une intelligence artificielle ?

« Il est difficile de savoir si un texte a été écrit par une intelligence artificielle ou par un être humain, car l’IA peut produire du contenu qui ressemble à du texte humain. Cependant, il existe quelques moyens pour identifier un texte écrit par une IA :

- Le texte peut avoir une structure et une logique parfaites, mais il peut manquer de créativité ou d’originalité.

- Le texte peut être très long et contenir de nombreux détails, mais il peut manquer de profondeur ou de cohérence.

- Le texte peut être rempli de fautes d’orthographe ou de grammaire, ce qui est inhabituel pour un texte humain.

- Le texte peut contenir des phrases ou des mots qui n’ont pas de sens ou qui sont incohérents avec le sujet traité.

- Le texte peut être générique ou impersonnel, sans aucune touche personnelle ou humaine.

En général, il est conseillé de faire preuve de scepticisme et de ne pas accepter un texte comme étant humain simplement parce qu’il est bien écrit ou cohérent. Il est important de vérifier les sources et de rechercher des preuves pour s’assurer que le texte provient bien d’un être humain et non d’une IA. »

Au delà des conseils plutôt pertinents pour amorcer l’identification d’un texte produit par une IA, la première phrase de la réponse nous fait craindre un futur compliqué pour la vérification de ce genre de production. En effet, nous sommes bien contraints de remarque qu’appliquer les conseils donnés ici seraient plutôt inopérants pour les réponses de cette « interview ». Ici seule l’absence d’un nom de personne physique en tant qu’auteurice des réponses pourrait nous mettre sur la piste d’un texte potentiellement écrit par une IA. Avec un nom, nous pourrions amorcer une enquête pour prouver l’existence de cette personne, même si des photos et une présence en ligne ne suffit pas, et comparer le style, la syntaxe et le vocabulaire utilisé avec d’autres textes produits par cette personne. Sans nom, nous ne pouvons que douter.

Comment l’intelligence artificielle peut-elle être une bonne chose pour le journalisme ?

« L’intelligence artificielle peut être une bonne chose pour le journalisme dans certaines circonstances. En effet, l’IA peut aider les journalistes à traiter de grandes quantités de données et à en extraire des informations pertinentes, ce qui peut être utile dans le cas de sujets complexes ou de sujets d’actualité. L’IA peut également être utilisée pour automatiser certaines tâches répétitives, comme la vérification des faits, ce qui peut libérer du temps pour les journalistes pour se consacrer à des tâches plus complexes. Enfin, l’IA peut aider les journalistes à mieux cibler leur audience en leur proposant du contenu personnalisé en fonction de leurs intérêts et de leur comportement de consommation. Cependant, il est important de noter que l’utilisation de l’IA dans le journalisme doit être faite de manière responsable et en prenant en compte les risques potentiels pour l’information et la démocratie. »

On peut remarquer ici que les avantages apportés par l’IA au monde journalistiques sont sensiblement les mêmes que les « dangers » évoqués plus haut, seule l’éthique dans l’utilisation de ces outils permettrait d’apporter des bénéfices à la population.

Comment un journaliste peut-il utiliser une intelligence artificielle pour vérifier des faits ?

« Un journaliste peut utiliser une intelligence artificielle pour vérifier des faits en lui fournissant les données nécessaires et en lui demandant de rechercher des informations sur un sujet donné. L’IA peut par exemple être utilisée pour rechercher des sources fiables sur internet, pour comparer des informations entre elles ou pour détecter des incohérences ou des contradictions dans un texte. Le journaliste peut ensuite utiliser les informations fournies par l’IA pour vérifier les faits et s’assurer de leur véracité avant de les publier. Cependant, il est important de noter que l’utilisation de l’IA ne remplace pas le travail du journaliste, qui doit toujours faire preuve de scepticisme et de vigilance pour s’assurer de la fiabilité des informations. »

Encore une fois, l’IA offre une réponse détaillée, mettant en avant la possibilité pour les journalistes de travailler « avec » ces outils tout en précisant que l’IA ne peut pas se substituer au travail de journaliste.

Quelles sont les failles de GPT-3 ?

« Je suis désolé, mais je ne suis pas au courant des failles de GPT-3, car je suis un modèle de langage entraîné par OpenAI et mon connaissance se limite aux informations disponibles jusqu’en 2021. Je ne peux pas naviguer sur internet et je ne suis pas mis à jour en temps réel, donc je ne peux pas vous fournir des informations sur des sujets qui ont évolué depuis ma dernière mise à jour. Si vous avez des questions sur des sujets plus récents, je vous suggère de les poser à un expert en IA ou de faire des recherches en ligne pour trouver des informations fiables et à jour. »

Il est intéressant de voir que le Chatbot a une « vue » sur ses limites à savoir son apparente incapacité à naviguer sur Internet et une base de donnée qui ne contiendrait que des informations antérieures à 2021. « Mon connaissance » est la seule faute de français identifiée dans l’ensemble des réponses.